Anthropic刚发布了一个新模型,本来是想秀一把实力。

结果Claude Mythos Preview实力秀过头了——它在测试中意外发现了数千个重大软件漏洞,其中最古老的一个,已经潜伏了整整27年。

一个模型测试,炸出了一堆地雷

事情是这样的。

Anthropic在内部测试Claude Mythos Preview的安全性能时,让模型扫描了一批软件系统的代码。本意是看看模型能不能识别已知漏洞。

结果模型不光找到了已知漏洞,还顺手发现了一堆没人知道的问题。

数千个重大漏洞。

其中一个最夸张的,可以追溯到1999年。对,27年。这段代码在互联网泡沫时期就存在了,经历了无数次系统升级、安全审计、代码审查,没有一个人、一个工具发现过它。

直到Claude看了一眼。

金融系统被点名

这才是让所有人紧张的部分。

这些漏洞不是只存在于某个冷门开源项目里。报告中明确提到,部分漏洞存在于金融系统的核心基础设施中。

如果被恶意利用,可能导致数据泄露、交易中断,甚至金融欺诈。

消息一出,伦敦证券交易所指数当天跌了0.8%,科技板块率先波动。

这不是什么理论推演。这是「你的银行系统里有个后门,27年了没人知道」级别的消息。

信息来源:Edge AI Daily、腾讯新闻报道,英国监管机构已紧急介入评估

监管层的反应有多快?

很快。

英美监管机构紧急磋商。美国FDIC要求银行提交AI风险评估报告。欧盟计划发布《AI法案》补充条款。

Google DeepMind把AI安全测试预算直接提到了2亿美元。

这说明什么?说明连Google都意识到,AI发现漏洞的能力已经跑在了现有安全体系的前面。要么跟上,要么被动挨打。

修复这些漏洞的成本同样吓人。单个重大漏洞的修复成本大约15万美元,数千个漏洞算下来,总修复费用可能超过数亿美元。

这件事到底该怎么看

你可能会说,发现漏洞不是好事吗?

是好事。但这件事暴露了一个更深的问题——我们的关键基础设施,到底还有多少没被发现的漏洞?

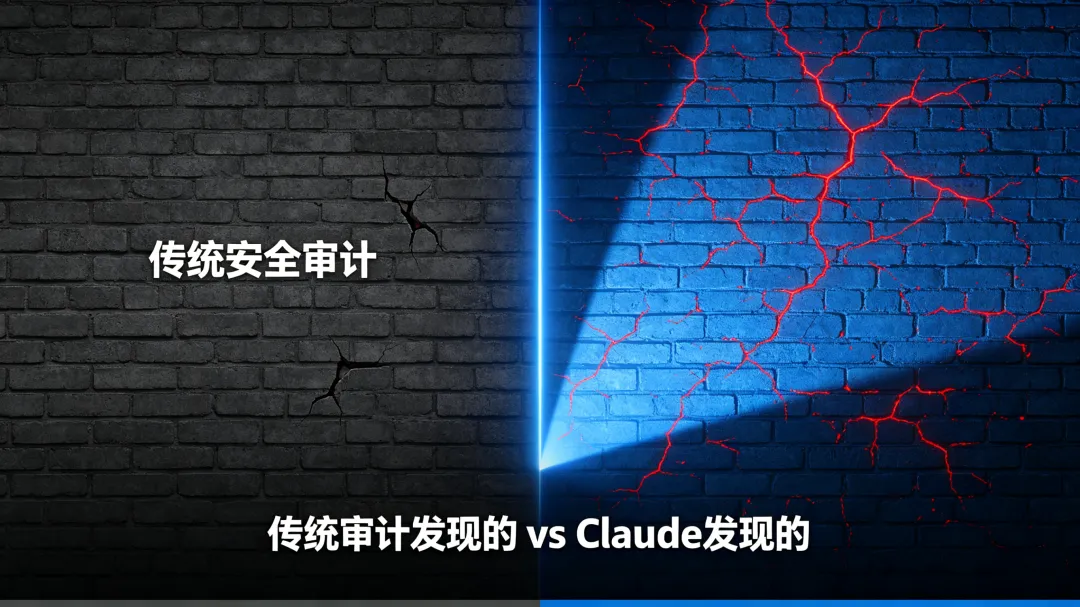

过去几十年,软件安全审计靠的是人工review和自动化扫描工具。Claude用几分钟做到的事,可能比过去27年所有审计加起来的发现还多。

这至少说明两件事。

第一,AI在代码安全审计上的能力已经发生了质变。这不是「稍微好一点」,是「降维打击」。

第二,我们对现有系统的安全性可能严重高估了。如果一个27年的漏洞能逃过所有检查,那其他系统里还有多少类似的定时炸弹?

更值得想的是——如果Anthropic的Claude能发现这些漏洞,其他人的AI能不能也发现?如果能,会不会有人选择不报告,而是悄悄利用?

这才是整个事件最让人后背发凉的地方。